当客岁GPT4公布的时候成都调研公司,咱们大吃一惊,哪有这么的事;过几许期间后渐忘了,因为你也莫得效过。

本年霎时出现Sora,惊呆了,笔墨就能出来一幕剧;难说念只是是如斯吗?不是,王人讲明咱们莫得效上。

我的道理是,需要让一部分东说念主先用起来。

本年,围绕AI的最前沿科技依旧是大热点的话题,而上述这段话恰是来自世界政协委员周汉民。此提议一出,可谓是立即在网上掀翻了不小的飞腾。

而之是以成都调研公司会有如斯提议,是因为在周汉民看来,关于这些最前沿的工夫是要尽快体验和使用的:

如果你不够了解,就会处于颓势。

因为它所带来的是以点带面、连线成片的浩大影响效应。

不丢脸出,其中枢不雅点,就是工夫需要被用起来,要尽快地作念到落地。

而这也应了自ChatGPT引爆AIGC大飞腾以来的一个大趋势,即从大模子的磨砺渐渐向推理过渡,从底层的模子层渐渐向顶层的诈欺,以致是更进一步的行业或破钞者诈欺发展。

但毕竟像Sora这么的工夫亦然刚问世不久,诸多工夫和体验花样还并莫得对外绽开;而大谈话模子(LLM),则是已然火了整整一年多余。

由此能逸意象的一个问题即是——LLM,咫尺用得如何样了?

让咱们先拿医疗行业的施行举个例子

。

不管是以往传统AI,照旧当下顶流大模子,医疗规模一直王人是一个相称典型且亟需AI相沿的大行业场景,AI的融入,能肉眼可主意提高医疗服务的着力和质地、应付医疗资源转折的挑战、以及推动个性化医疗的发展等。

让咱们从电子病历上来个“以小见大”。

一方面,与之相干的做事不错说悼念常的芜乱,多量的文本信息需要东说念主为手动地去输入,在有些医师详备跟踪患者的情况下,病历以致可长达万字之多,极容易出现失实录入的情况。

另一方面,电子病历又会影响到医师和医疗做事者的判断,因为他们需要对电子病历有着深刻的明察,以便发现潜在的健康风险和疾病模式。

其在医疗做事规范中的紧要性可见一斑。而诸如LLM这么的AI工夫,恰巧豪爽很好地抖擞对多量文本内容的信息化、数字化以及深刻交融,恰巧不错用来作念病历的归纳、纠错和紧要信息的索求,而且这类活儿恰好苦到,或者累到……总共“往往东说念主类”王人不太风景干。

那么这些做事让AI来代劳,又能带来什么样的着力呢?咱们不妨以深耕医疗行业多年,况且如故匡助盛大头部三甲病院完成信息化和数字化的卫宁健康为标杆来一辩论竟。

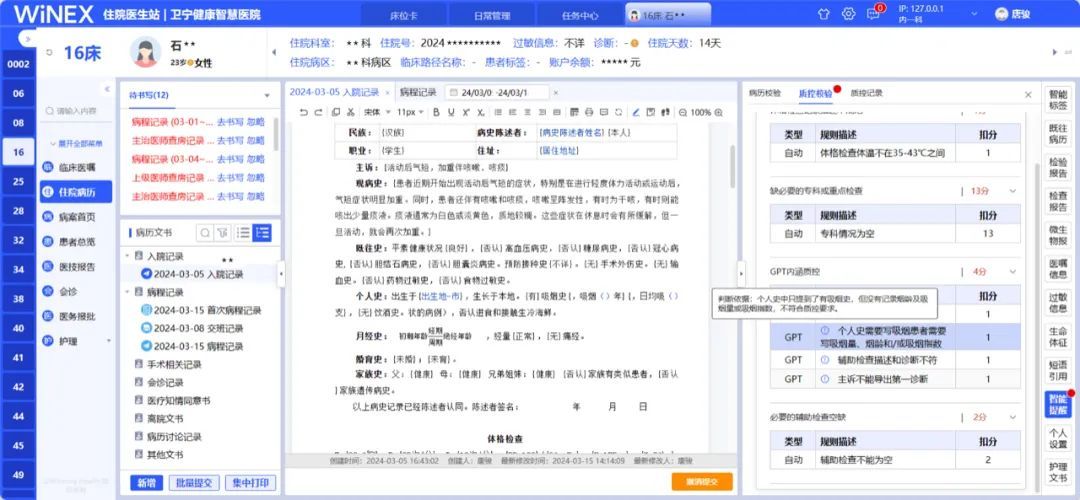

卫宁给出的一套科罚决议叫作念WiNEX Copilot,如其名,它在医疗规模所阐扬的作用,恰是充任医师和相干做事者的AI助手。

在WiNEX Copilot病历告示助手的加握之下,医师们不错一键生成适合医疗表率和匹配患者个东说念主病情的病历告示段落,大幅减少病历纪录书写做事量,不错让他们更专注于会诊和调治。

从暴露的数据来看,只需要给它8个小时(举例在医师放工后的期间),病历告示助手就不错处理近6000份病历,格外于三甲病院12名医师一天做事量的总额!

而这也还仅是LLM上岗医疗的一隅,WiNEX Copilot还具备怎么的实力,咱们无间往下看。

AI医师助手为什么值得领有

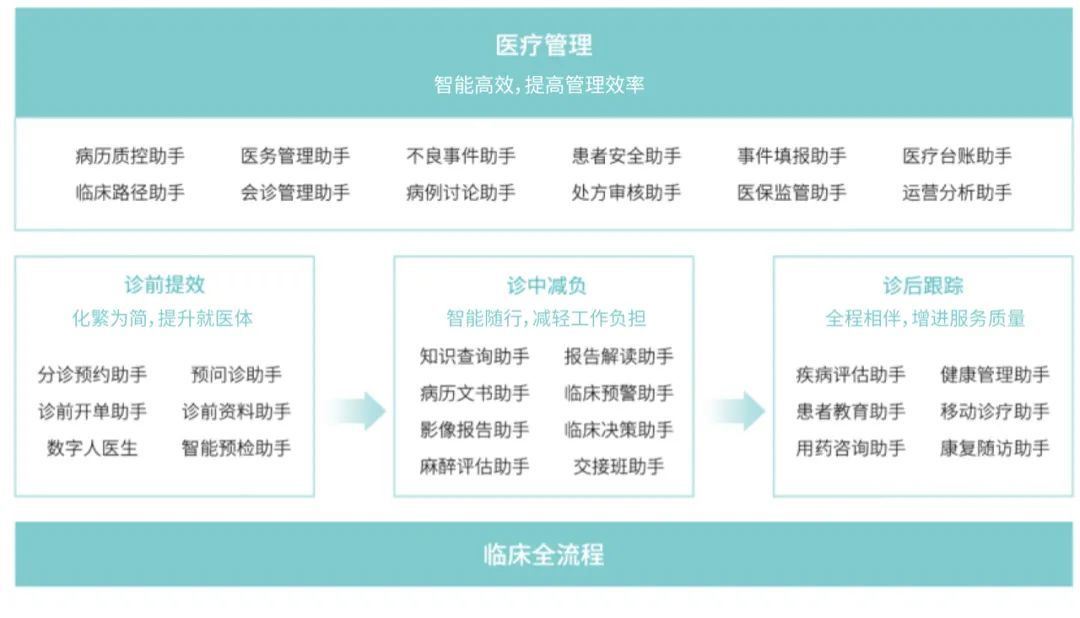

实质上,WiNEX Copilot已深度集成到卫宁新一代居品WiNEX中,除了前边提到的病历告示助手,市场调研咱们还不错举几个有代表性的场景来进一步展示它的实力。

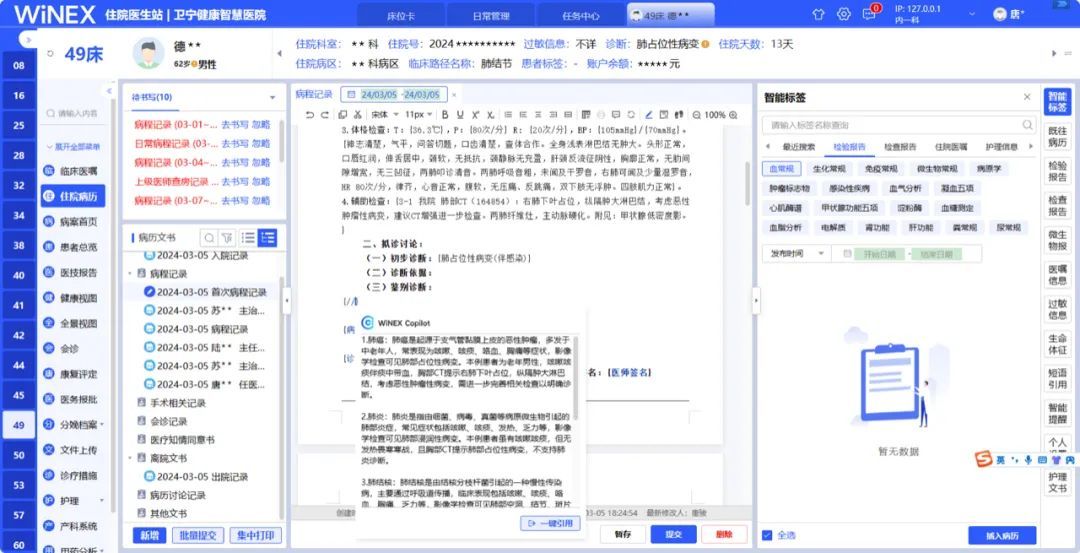

在发射科,WiNEX Copilot影像论说助手就能匡助医师擢升会诊质地,镌汰误诊率。

把柄影像医师写下的影像查验所见情况笔墨刻画,这个小助手就不错自动生成影像会诊论断,包括具体的病变称号或会诊、随访提议等。

医师可基于对自动生成内容准确度的判断,天真选择一键援用或从头生成。

关于影像论说的竣工书写做事来说,这就格外于东说念主类医师和AI合作完成了一轮交叉查对,缓慢影像科医师的做事做事,镌汰误诊漏诊风险,提高影像论说质地。

特别是遭受有屡次查验纪录的随访患者,系统可自动调出相干的论说扶植对比分析,让会诊论断更严谨、竣工、准确。

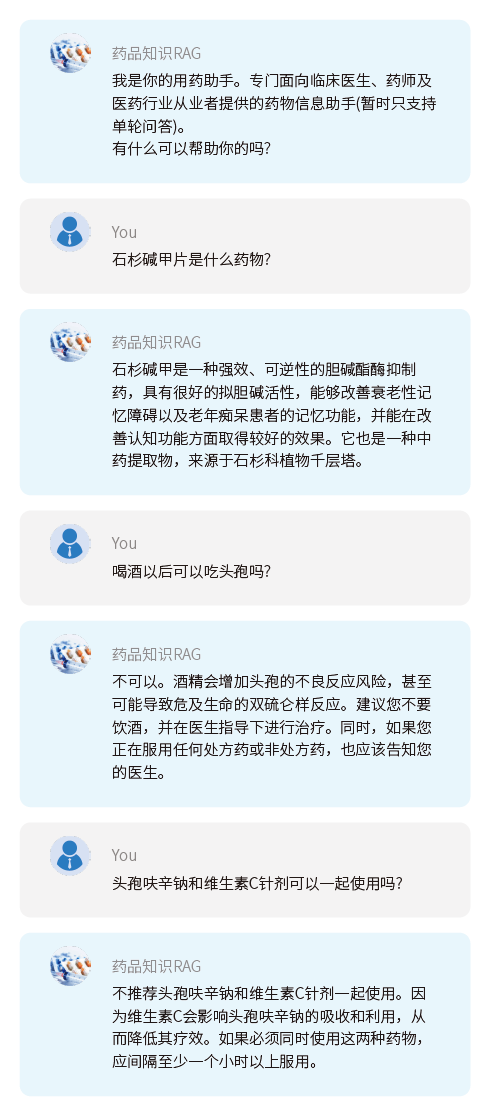

再如WiNEX Copilot药品常识助手,不仅能从海量的医药文件和数据库中快速检索出与用户查询相干的精确常识,还能基于这些信息生成浅较着了、内容准确的回应。

这么一来,就格外于给医护东说念主员提供了一个外挂的药品常识库,濒临抑止更新的药品信息,也能跟得上变化。

就像这么,WiNEX Copilot对接上具体细分的医疗业务场景,就会立即摇身造成医护东说念主员的全方向、多维度智能助手。

咫尺WiNEX Copilot如故集成在卫宁健康WiNEX全系列居品中,遮掩病院照应、医师增效和患者服务等100多个临床诈欺场景。

总共这一切,看着炫目又实用,一定需要氪不少金才能领有吧?

划重心了,它的硬件老本相称合理,性价比也许出乎你的料想。而且更紧要的是其实质部署和诈欺也相称高效,能在职何一家如故使用WiNEX系统的病院连忙“上岗”。

这,又是如何作念到的?

用CPU加速AI落地

不错把AI居品作念到既逼近用户需求,又能把它落地和部署的着力拉满,天津零售业神秘顾客暗访这关于卫宁健康来说其实是相得益彰的。

动作国内医疗信息化规模龙头企业,卫宁健康服务的各类医疗卫盼望构用户达 6,000 余家,其中包括 400 余家三级病院,遮掩贤慧病院、区域卫生、下层卫生、人人卫生、医疗保障、健康服务等多个规模。

在工夫方面,卫宁健康还领有成体系的系统研发、AI和大数据工夫转念身手。

到了大模子时间,卫宁健康多年积累的医疗行业警戒、高质地磨砺数据和研发身手就起到了关节作用——

在三项上风的抽象下,推露面向医疗垂直规模的大模子WiNGPT。

WiNGPT恰是WiNEX Copilot的底层AI引擎,它一个特出特色就是聚会高质地医疗数据,可针对医疗场景优化和定制。

从2023年头运行研发,到10月认真发布时预磨砺数据20G,微调数据更是达到50万条。

WiNGPT另一个特出特色就是能高效委派、部署和诈欺了。

卫宁健康为此选择与英特尔合作,通过软硬适配、优化模子算法等技能,把在CPU上部署的生奏着力搞到接近GPU的水平。

为什么要选择这一条工夫道路,与CPU自己的身手和医疗行业的特色王人脱不开关系。

起程点,高端CPU连年来对准AI市集握续发力,内置的AI加速工夫的性能如故豪爽抖擞需求。

这一步在诈欺部署方面更敬重的推理算力方面阐扬得更为特出。

举例卫宁选用的第五代英特尔® 至强® 可推广处理器,内置了AMX(高档矩阵推广)加速工夫。比拟相通内置AMX的第四代至强® 可推广处理器,得益于自身在微架构和举座性能上的擢升,第五代的推感性能擢升高达42%;而与内置了矢量加速教导集,即深度学习加速(DL Boost)工夫的第三代至强® 可推广处理器比拟,其AI磨砺和推感性能擢升更是高达14倍。

其次,在医疗行业数字化过程中,CPU已有相称世俗的使用基础。

这少量行内东说念主王人知说念,世俗诈欺的电子病历系统、病院资源诡计系统以及患者照应系统等等,王人需要处理多量的数据,况且条件高可靠性和及时性。

因此CPU早就如故是医疗行业常常采购的建立,不像专用AI加速器或者GPU还需要特批采购经过,选择在CPU上落地AI诈欺当然更平滑顺畅。

再进一步来说,CPU得益于这种基础,积累了弥散的工夫东说念主才储备,更易于优化和使用。

CPU人人基础世俗,易于使用、有较出色的可靠性,在医疗行业历经训练的同期,也蕴蓄了大王人相干专科东说念主才。

这些东说念主才,和卫宁健康我方的专科东说念主才,再加上合作伙伴英特尔方面的工程师互助,鼓励AI诈欺落地时,不管业务决议照旧硬件优化方面王人能作念到就绪进程更高,上手更快。

抽象来看,如果这么一个AI 诈欺能在领有世俗部署、易于取得,便于诈欺和优化,能兼顾通用诡计又能作念推理加速的平台上落地,且无用为此导入异构带来的多样复杂性,当然就会收成高效的诈欺阐扬、落地速率和更会有的老本竞争力。

具体到实质阐扬上——在卫宁健康和英特尔共同对WiNGPT的推理进行优化后,擢升了内存使用着力,并通过对 PyTorch在CPU平台上主要算子的算法进行革命,进一步加速了深度学习框架的推理速率。

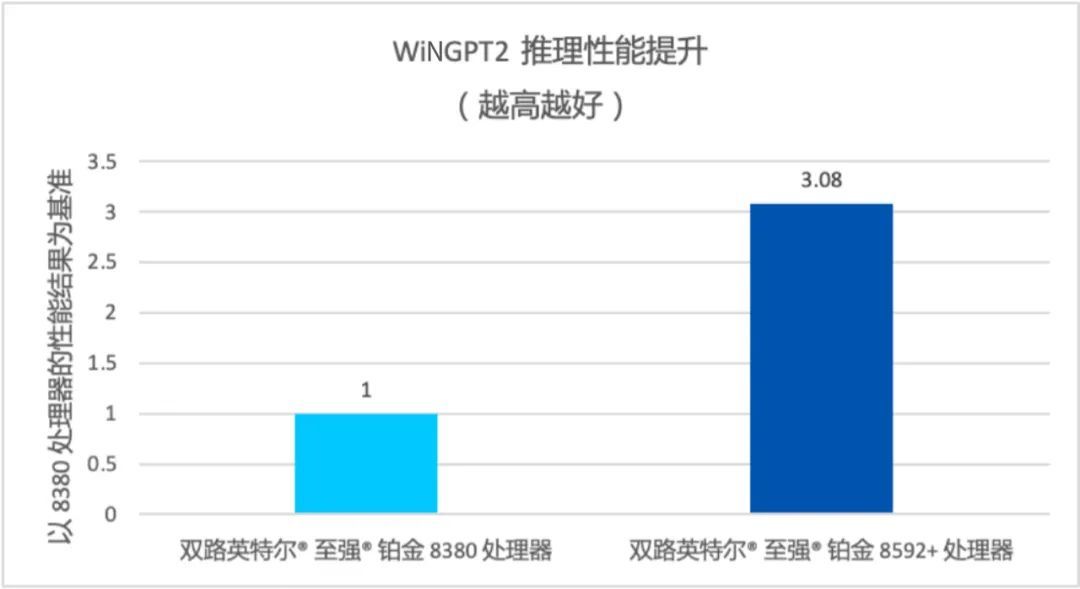

而在测试中,将基于第五代英特尔® 至强® 可推广处理器的决议与基于第三代英特尔® 至强® 可推广处理器的决议进行了对比,为止暴露,新一代处理器可将性能擢升多达 3 倍。

同期,CPU决议还具有不错更扬弃推广推理实例数目的上风,况且不错在多样平台上适配进行推理。

总共这些上风类似的为止,就是能让每家如故用上卫宁新一代居品WiNEX系统的病院,王人有契机领有WiNGPT相沿的全套WiNEX Copilot医护智能助手。

CPU成了大模子时间下的另一种解法

那么咱们咫尺再来往应领先的阿谁问题:如何把LLM用好?

起程点相称笃定的是,咫尺的大模子已然是步入到了拼谁不错“快好省”地用起来的阶段。

这种趋势从客岁便已运行崭露头角,举例从ChatGPT问世之后,国表里先是呈现出了百模大战这种以磨砺为基础的态势。

此后从下半年于今,则是在磨砺完大模子的基础之上,更多企业王人在念念考的则是如何将LLM信得过地扎根到行业里。

卫宁这个例子,不错说是较为得手的范例,这不仅是得益于它弥远在以大模子为代表的前沿工夫上的跟进与创新,更是基于它关于医疗行业的深耕;因此才不错收拢医疗规模的痛点,并让LLM在其中阐扬更大的价值。

由此来看,如何能把LLM用好,需得先有深厚的行业积累、有明察,方可精着实入。

虽然,全球步入大模子时间之后,GPU或专用的加速器无疑成为了香饽饽,况且越发呈现出令嫒难求的表情。

关联词这就是总共场景中的最优解吗?不见得。

正如咱们刚才所言,岂论是传统的AI工夫亦或是LLM,要想很好的落地需得是作念到“快好省”。

如果在部署时盲目堆GPU,一是可能会出现算力上的过剩以致枉然,二是在落地着力上可豪爽不上那么高,同期老本也可能会情随事迁。

因此卫宁pick老牌芯片巨头英特尔的最新一代至强,亦然从性能、行业、东说念主才、到老本等一系列身分深刻考量之后所作念出的较优解;而从为止上来看,CPU也正在实实在在地助力着LLM在医疗规模大展拳脚。

是以,到了今天,咱们会霎时发现,一个有道理的新趋势是:CPU成了大模子落地的另一种解法。